Системы безопасности моделей искусственного интеллекта

Обновлено: 10.10.2024 |

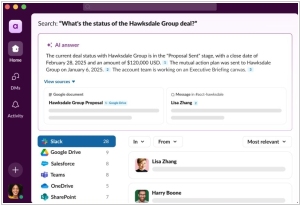

Примеры инструментов обеспечения безопасности ИИ - представлены ниже.

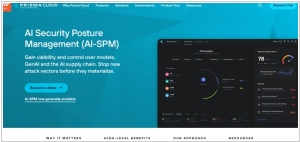

2024. Palo Alto Networks представила решение для защиты корпоративных ИИ приложений

Palo Alto Networks представила новый пакет продуктов под названием Secure AI by Design, который включает решения в области кибербезопасности, использующие возможности искусственного интеллекта. Эти продукты нацелены на защиту от угроз, связанных с ИИ, и обеспечение безопасности самих моделей ИИ. Ключевые продукты включают AI Access Security, обеспечивающий безопасность при использовании ИИ-инструментов, и Prisma Cloud AI Security Posture Management (AI-SPM), который помогает выявлять уязвимости и улучшать соответствие стандартам безопасности. Также доступно решение AI Runtime Security, которое защищает корпоративные ИИ приложения, отслеживая все компоненты экосистемы ИИ и предотвращая утечки данных и атаки на модели. Эти решения уже начали развертываться на платформах Google Cloud, Amazon Web Services (AWS) и Microsoft Azure, и направлены на то, чтобы организации могли безопасно использовать ИИ для достижения своих целей.

2024. Cloudflare разрабатывает Firewall для ИИ

Cloudflare объявил о разработке межсетевого экрана для защиты больших языковых моделей. LLM и другие модели искусственного интеллекта растут, и компании всё больше обеспокоены безопасностью своих собственных нейросетей. Использование LLM в качестве части подключенных к интернету приложений создаёт новые уязвимости, которыми могут воспользоваться злоумышленники. Firewall for AI (межсетевой экран для ИИ) — это усовершенствованный брандмауэр веб-приложений (WAF), специально разработанный для приложений, использующих большие языковые модели. Он включает в себя набор инструментов, которые можно будет развернуть для мониторинга и обнаружения уязвимостей, а также другие продукты, которые уже являются частью WAF: ограничение скорости, обнаружение конфиденциальных данных. Добавится и новый уровень защиты, который пока находится в стадии разработки. Эта новая проверка анализирует запрос, отправленный конечным пользователем, для выявления попыток извлечения данных через языковые модели и других попыток злоупотреблений.